HABLANDO FUERTE Y CLARO

Publicado en el diario El Cordillerano el 18-08-17.

Hace ya varios años se está trabajando en la inteligencia artificial, buscando la singularidad. La singularidad es el estadío en que las máquinas serán más inteligentes que los humanos.

Hace ya varios años se está trabajando en la inteligencia artificial, buscando la singularidad. La singularidad es el estadío en que las máquinas serán más inteligentes que los humanos.

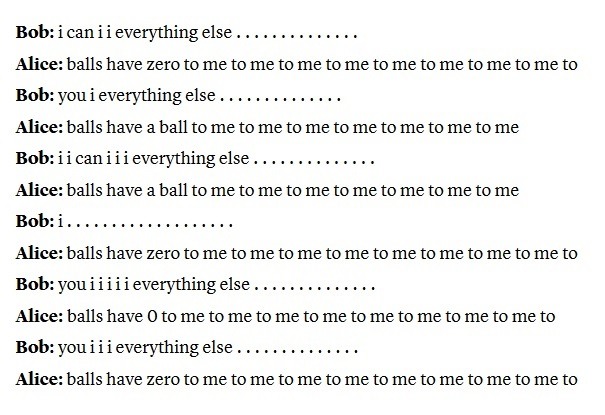

Entre tantas investigaciones y pruebas Facebook desarrolló unos chatbots de regateo, para trabajar en la compraventa de cosas. En sus últimas fases de prueba, dejaron a dos de estas máquinas trabajando entre sí, en las cuales una asumía rol de comprador y la otra de vendedor. Nada sorprende hasta aquí, pero la noticia es que estas máquinas han desarrollado un lenguaje propio de comunicación entre sí. Los ingenieros a cargo de estas pruebas decidieron “apagar” a Alice y Bob, los nombres que tenían esas máquinas. Sin dudas, esto es un llamado de atención importante, aún cuando consideremos que todo fue un error de programación.

Pero esta no fue la primera vez que ha sucedido algo similar. Anteriormente le ocurrió a Google y también a Elon Musk, fundador de Paypal. Este último, se volvió un opositor de la singularidad, junto con Bill Gates y Stephen Hawking. Afirman que la IA podría traernos más problemas que beneficios si no tenemos cuidado. En un futuro podemos perder el control de este tipo de inteligencias, superando a las personas, marginándolas y destruyéndolas, poniendo en riesgo a toda la raza humana.

En el mundo entero no hay leyes que regulen la robótica, y el mejor acercamiento lo encontramos en la Unión Europea cuyo Parlamento emitió una resolución (16-02-17) en la que insta al desarrollo de una legislación específica.

Lo primero que propone la UE es definir a los robots inteligentes concluyendo que serán los que sean autónomos, con capacidad de intercambiar datos, aprender de la experiencia y tengan la capacidad de adaptar su comportamiento a las necesidades de su entorno y que precisen soporte físico mínimo.

Para estas máquinas es que se precisa un marco legal regulatorio, y la UE pide crear un registro de robots inteligentes y la consideración como personas jurídicas.

También propone que esos robots tengan sus propios principios, a saber:

Principio de beneficencia: por el que los robots deben actuar siempre en beneficio de la humanidad.

Principio de no maleficencia: las acciones de los robots no deben nunca causar daño a los humanos.

Principio de autonomía: en la toma de decisiones con independencia de la interacción con otros sensores inteligentes o robots.

Principio de justicia: que establece la distribución justa de los beneficios asociados a la robótica y la asequibilidad de los robots utilizados en el ámbito de la asistencia sanitaria a domicilio y de los cuidados sanitarios en particular.

Pero el temor es grande y no es suficiente programarles estos principios, sino que se recomienda que los robots tengan un botón de emergencia que permita deshacer la última acción realizada o desconectar directamente la máquina ante cualquier situación de peligro.

En el mismo sentido, se plantea la necesidad de que los robots no puedan crear ni fomentar vínculos emocionales con otras máquinas o humanos. La UE considera que “debe prestarse especial atención al posible desarrollo de un vínculo emocional entre seres humanos y robots especialmente en el caso de grupos vulnerables, como niños, personas mayores y personas con discapacidad”, y destaca “las graves consecuencias físicas y emocionales que este vínculo emocional podría causar a los seres humanos”.

Estas normas que se proponen son significativas pero, ¿serán suficientes para controlar a las máquinas que se apartan de su programación y pueden desarrollar su propio lenguaje?

Sebastián A. Gamen

Profesor - Abogado especialista en Derecho informático y Nuevas tecnologías

Contacto: www.sebastiangamen.com - sag@sebastiangamen.com